Mô hình ngôn ngữ lớn (LLM) nói riêng, và trí tuệ nhân tạo (AI) nói chung, là một thị trường có tốc độ tăng trưởng cực nhanh trong một khoảng thời gian ngắn.

Và khi công nghệ này ngày càng được triển khai rộng rãi hơn xuyên suốt các ngành công nghiệp, từ tiếp thị đến thanh toán, hay bảo hiểm, thì tốc độ thực thi của nó cũng trở nên quan trọng hơn.

Hiển nhiên, gã khổng lồ bán lẻ trực tuyến Amazon không muốn đứng ngoài cuộc chơi. Đầu tháng 11 vừa qua, nhiều nguồn tin đã tiết lộ về một mô hình ngôn ngữ lớn mới đầy tham vọng đang được Amazon phát triển, và có thể sẽ được công bố chính thức trong tháng 12 tới đây.

Mô hình này có gì đặc biệt? Hãy cùng Tenten.vn tìm hiểu tiếp nhé!

Mô hình ngôn ngữ lớn là một mô hình máy học được đào tạo trên một lượng lớn dữ liệu ngôn ngữ để hiểu và tạo ra văn bản tự nhiên. Những mô hình này thường được xây dựng trên các kiến trúc mạng nơ-ron sâu, như mạng nơ-ron hồi quy (RNN) hoặc mạng nơ-ron chuyển giao (LSTM), nhưng các mô hình hiện đại thường sử dụng kiến trúc Transformer.

Một trong những mô hình ngôn ngữ lớn nổi tiếng nhất là GPT (Generative Pre-trained Transformer), và GPT-4 là phiên bản mới nhất của loạt mô hình GPT. GPT-4 được phát triển bởi OpenAI và có khả năng hiểu và tạo ra văn bản tự nhiên với kích thước rất lớn.

Những mô hình này thường được đào tạo trên dữ liệu đa dạng từ Internet, bao gồm văn bản từ trang web, sách, bài báo và nhiều nguồn dữ liệu khác. Sau khi được đào tạo, chúng có thể được sử dụng cho nhiều ứng dụng như tạo văn bản, dịch ngôn ngữ, trả lời câu hỏi, và nhiều nhiệm vụ khác trong lĩnh vực xử lý ngôn ngữ tự nhiên (NLP).

Có tên mã “Olympus”, mô hình ngôn ngữ lớn bí ẩn này được cho là một trong những mô hình nền tảng lớn nhất từng được huấn luyện, với hơn 2 nghìn tỷ tham số – tức gấp đôi so với đối thủ gần nhất của nó, mô hình GPT-4 tiên tiến đến từ OpenAI, vốn chỉ có 1 nghìn tỷ tham số mà thôi.

CEO Amazon, Andy Jassy, từng dự báo rằng AI tạo sinh sẽ giúp mang lại “hàng chục tỷ USD doanh thu”.

Nhưng trên thực tế, Amazon đã và đang bán các LLM do họ tự phát triển – bao gồm mô hình Titan – và do các startup AI khác phát triển, như Anthropic, mà Amazon có cổ phần lên đến 4 tỷ USD.

Việc huấn luyện và xây dựng các mô hình AI là rất tốn kém cả về tiền bạc lẫn tài nguyên. Vậy tại sao Amazon lại đầu tư một khoản khổng lồ cho mô hình ngôn ngữ lớn hoàn toàn mới như vậy?

Câu trả lời là bởi họ muốn kiểm soát số phận của chính mình trong thế giới AI, cũng như bắt kịp những cái tên tiên phong như OpenAI, Microsoft, Google, và thậm chí là Meta.

Mô hình ngôn ngữ lớn Olympus được dẫn dắt bởi Rohit Prasad, cựu lãnh đạo Alexa và là nhà khoa học trưởng của bộ phận trí tuệ nhân tạo tổng hợp (AGI) của Amazon.

Quyết định đầu tư phát triển LLM “nhà trồng” của Amazon nhiều khả năng nhằm mục đích tăng cường sức hấp dẫn cho các sản phẩm của họ, đặc biệt là Alexa và Amazon Web Services (AWS).

Dù chưa công bố thời điểm ra mắt cụ thể của Olympus, nhưng các nguồn tin cho biết LLM chỉ là một phần trong chiến lược lớn hơn của Amazon trong thế giới AI.

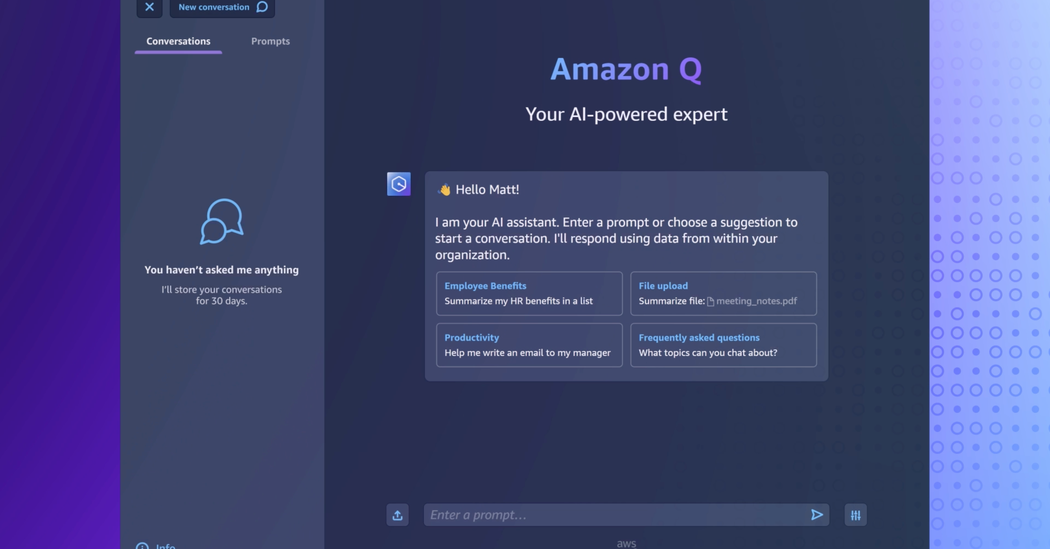

Một sản phẩm khác trong chiến lược nêu trên là chatbot AI dành cho khách hàng sử dụng AWS, mang tên Q. Sản phẩm này vừa được Amazon ra mắt chính thức vào ngày 29/11 vừa qua.

Theo đó, mức giá khởi điểm cho Q là 20 USD/người dùng/năm. Nó có thể trả lời được những câu hỏi như, “Làm cách nào để xây dựng một ứng dụng web bằng AWS”.

Q được huấn luyện dựa trên bộ dữ liệu tổng hợp suốt 17 năm vận hành của AWS. Do đó, nó có khả năng cung cấp cho khách hàng những giải pháp tiềm năng cho mọi vấn đề mà họ gặp phải với AWS.

Khách hàng sử dụng AWS có thể cấu hình Q bằng cách kết nối nó – và tùy biến nó với – các ứng dụng chuyên biệt của họ, cũng như các phần mềm như Salesforce, Jira, Zendesk, Gmail, và Amazon S3. Q sẽ lập chỉ mục tất cả các nội dung và dữ liệu đã được kết nối, “học hỏi” mọi khía cạnh liên quan doanh nghiệp, bao gồm cấu trúc tổ chức, mục tiêu, lẫn tên gọi các sản phẩm.

Từ web app, công ty có thể yêu cầu Q phân tích – ví dụ, những tính năng sản phẩm nào khiến khách hàng của họ gặp khó khăn và biện pháp khả thi để cải thiện chúng – hoặc upload một tập tin (Word, PDF, Excel…) rồi yêu cầu Q trả lời các câu hỏi liên quan tập tin đó. Q sẽ dựa trên những mối liên kết và dữ liệu hiện có, bao gồm dữ liệu riêng về doanh nghiệp, để đưa ra phản hồi tương ứng.

Chưa hết, Q còn có chức năng tạo hoặc tóm tắt nội dung như bài viết blog, thông cáo báo chí, email… Nó thực hiện hành động trên danh nghĩa người dùng, thông qua một loạt các plugin cấu hình được, như tự động tạo vé dịch vụ, thông báo cho các nhóm cụ thể trên Slack, và cập nhật dashboard trên ServiceNow.

Q cũng có thể phát hiện các sự cố kết nối mạng, phân tích cấu hình mạng để đưa ra các bước khắc phục.

Và Q còn liên kết với CodeWhisperer, dịch vụ tạo và biên dịch mã nguồn ứng dụng của Amazon. Khi vận hành bên trong một IDE được hỗ trợ (như CodeCatalyst của Amazon), Q có thể tạo các bài test để benchmark phần mềm dựa trên mã nguồn của khách hàng.

Nó đồng thời có thể tạo kế hoạch và tài liệu để triển khai các tính năng phần mềm mới, hoặc chuyển hóa mã nguồn và nâng cấp các gói, kho chứa, và framework mã nguồn.

CEO AWS, Adam Selipsky, cho biết một nhóm nhỏ lập trình viên trong Amazon từng sử dụng Q để nâng cấp khoảng 1.000 ứng dụng từ Java 8 lên Java 17 – và test chúng – chỉ trong vòng 2 ngày!

Quantum AI là gì? 6 lĩnh vực ứng dụng thực tế của Quantum AI

Google mở rộng quan hệ đối tác với Anthropic để tăng cường an toàn AI